La notizia in breve

Google ha aggiornato la documentazione ufficiale comunicando che, dal 7 maggio 2026, i risultati avanzati basati sulle FAQ non vengono più mostrati nella Ricerca Google.

Il cambiamento riguarda tre livelli:

- la SERP, perché le FAQ non vengono più visualizzate come rich result;

- Search Console, perché i report dedicati verranno rimossi;

- le API, perché il supporto specifico ai FAQ rich results verrà dismesso.

Per molti siti, però, l’impatto reale sarà inferiore al rumore della notizia. Google aveva già ridotto pesantemente la visibilità delle FAQ in SERP nel 2023. La rimozione del 2026 è quindi meno una rivoluzione improvvisa e più la chiusura definitiva di una fase già iniziata da tempo.

La timeline dell’eliminazione

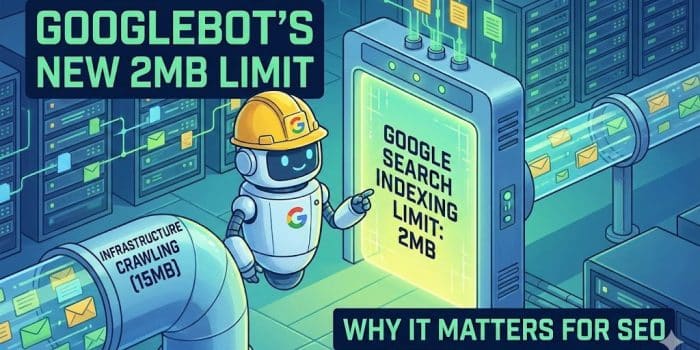

Google ha distribuito la rimozione su più momenti, separando la parte visiva dalla parte di reporting e dalla parte API.

| Data | Cosa cambia | Impatto SEO |

|---|---|---|

| 7 maggio 2026 | I FAQ rich results non appaiono più nella Ricerca Google | Le FAQ non occupano più spazio aggiuntivo sotto lo snippet organico |

| Giugno 2026 | Rimozione dei report dedicati e del supporto nel Rich Results Test | Search Console non mostrerà più enhancement e search appearance specifici |

| Agosto 2026 | Rimozione del supporto nella Search Console API | Dashboard, script e sistemi di reporting automatizzati dovranno essere aggiornati |

La distinzione è importante. Un sito può perdere una feature visiva senza subire un calo di ranking. Allo stesso modo, la scomparsa di un report in Search Console non significa che Google smetta di leggere completamente i dati strutturati presenti nella pagina.

FAQ rich result non significa FAQPage schema

Il punto tecnico centrale è questo: FAQ rich result e FAQPage schema non sono la stessa cosa.

Il FAQ rich result era il formato visuale che Google poteva mostrare in SERP: una serie di domande espandibili sotto il risultato organico. Era una feature di presentazione, controllata da Google e concessa solo quando il motore decideva di mostrarla.

FAQPage, invece, è un tipo di dato strutturato definito da Schema.org. Serve a descrivere una pagina che contiene domande frequenti e relative risposte.

La differenza è sostanziale:

- il rich result è una resa grafica nella pagina dei risultati;

- lo schema è una descrizione semantica del contenuto;

- Google può decidere di non mostrare più il primo senza cancellare il secondo;

- un markup può restare valido anche quando non genera più un enhancement visibile.

Questa distinzione dovrebbe guidare ogni decisione operativa. Chi rimuove tutto in blocco rischia di confondere un cambiamento di interfaccia con un cambiamento di linguaggio semantico.

Perché Google ha rimosso i FAQ rich results

Google non ha bisogno di spiegare ogni modifica della SERP con un documento strategico. Tuttavia, osservando l’evoluzione degli ultimi anni, la direzione è abbastanza chiara.

I FAQ rich results erano diventati una leva SEO troppo facile da replicare. Bastava aggiungere alcune domande in fondo a una pagina, implementare il markup corretto e sperare di occupare più spazio nella SERP.

Il problema non era il formato in sé. Le FAQ possono essere utilissime. Il problema era l’uso industriale della feature: domande generiche, risposte banali, keyword mascherate da contenuto utile, blocchi inseriti solo per ottenere più pixel nei risultati di ricerca.

Quando una feature nasce per aiutare l’utente ma viene trasformata in una scorciatoia tattica, Google tende a fare tre cose:

- riduce la visibilità della feature;

- limita l’idoneità a categorie specifiche di siti;

- rimuove o ridimensiona il supporto quando il valore per l’utente non giustifica più il costo della feature.

È esattamente ciò che è successo con le FAQ. Nel 2023 Google aveva già limitato fortemente la visualizzazione dei rich results FAQ, riservandoli soprattutto a siti governativi e sanitari autorevoli. Nel 2026 la feature viene ritirata del tutto.

Il vero impatto SEO: meno SERP real estate, non meno ranking

La perdita principale riguarda lo spazio visivo in SERP. Quando le FAQ venivano mostrate, il risultato organico poteva diventare più alto, più evidente e più ricco rispetto ai risultati concorrenti.

Questa espansione poteva avere effetti su:

- CTR, perché il risultato era più visibile;

- percezione di autorevolezza, perché la pagina sembrava più completa;

- prequalificazione dell’utente, perché alcune risposte erano già visibili prima del click;

- occupazione della SERP, perché un risultato espanso spingeva più in basso gli altri risultati.

Ma bisogna evitare letture semplicistiche. La rimozione dei FAQ rich results non equivale a una penalizzazione. Non significa che le pagine con FAQ perdano ranking. Non significa che il markup FAQ sia diventato un segnale negativo.

Significa che una specifica leva di presentazione non è più disponibile.

In pratica, il ranking continua a dipendere da pertinenza, qualità del contenuto, intento di ricerca, autorevolezza, esperienza utente, segnali tecnici e contesto competitivo. Le FAQ non vengono più premiate con un formato visuale dedicato, ma una pagina ben strutturata resta una pagina più leggibile, più utile e potenzialmente più forte.

Perché molti siti non vedranno grandi variazioni

Per gran parte dei siti commerciali, editoriali, affiliati ed e-commerce, i FAQ rich results erano già scomparsi o diventati estremamente rari dopo l’aggiornamento del 2023.

Questo significa che il calo non si vedrà necessariamente nei dati di maggio 2026. In molti casi il calo reale è già avvenuto tra il 2023 e il 2024, quando Google ha iniziato a mostrare le FAQ solo in contesti molto limitati.

Per questo motivo, chi analizza il traffico deve fare attenzione a non attribuire automaticamente ogni variazione organica alla rimozione del supporto FAQ.

Un calo di traffico nel periodo può dipendere da:

- modifiche di ranking indipendenti;

- aggiornamenti algoritmici;

- stagionalità;

- cambiamenti nel layout della SERP;

- presenza di AI Overviews o altri elementi generativi;

- variazioni nella domanda di ricerca;

- cambiamenti nei competitor.

L’errore classico sarebbe guardare una linea discendente in Search Console e dire: “È colpa delle FAQ”. Serve invece un’analisi per query, pagina, periodo, paese e dispositivo.

Cosa succede a Search Console

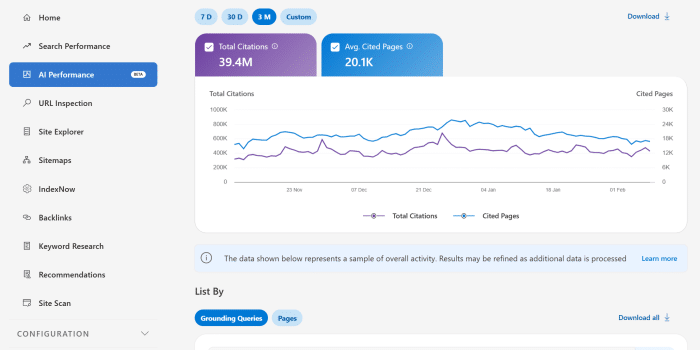

La parte meno spettacolare, ma più importante per chi fa SEO in modo professionale, riguarda Search Console.

Google rimuoverà i report dedicati ai FAQ rich results. Questo significa che non sarà più possibile usare quella specifica search appearance per analizzare impression, click, CTR e posizione media delle pagine che avevano generato risultati FAQ.

Per siti piccoli può sembrare un dettaglio. Per siti grandi, agenzie, network editoriali ed e-commerce con report automatici, invece, è un punto operativo rilevante.

Bisogna controllare:

- dashboard Looker Studio che filtrano per search appearance FAQ;

- script Python o Apps Script che interrogano la Search Console API;

- report ricorrenti inviati ai clienti;

- sistemi di alert basati su variazioni di enhancement;

- template di audit SEO che includono il controllo FAQ rich result come KPI.

Il rischio non è solo perdere un dato. Il rischio è mantenere in vita metriche che non significano più nulla, generando report sporchi, errori API o interpretazioni sbagliate.

Bisogna rimuovere il markup FAQ?

La risposta più corretta è: dipende dalla qualità del markup e dallo scopo delle FAQ.

Rimuovere automaticamente tutti i dati strutturati FAQ è una reazione eccessiva. Google aveva già chiarito nel 2023 che i dati strutturati non utilizzati per un rich result non creano problemi alla Ricerca, purché siano corretti e coerenti con il contenuto visibile.

In generale:

- se le FAQ sono utili all’utente, possono restare;

- se il markup è tecnicamente valido, non c’è urgenza di eliminarlo;

- se le domande sono artificiali, vanno riscritte o rimosse;

- se il markup non corrisponde al contenuto visibile, va corretto;

- se le FAQ sono generate da plugin obsoleti, serve un audit tecnico;

- se il sito ha migliaia di FAQ duplicate, conviene rivedere il modello editoriale.

La domanda non deve essere: “Google mostra ancora il rich result?”

La domanda deve essere: “Queste FAQ migliorano davvero la pagina?”

FAQ utili e FAQ inutili: la differenza strategica

La rimozione dei rich results obbliga a separare le FAQ editoriali dalle FAQ cosmetiche.

Le FAQ editoriali rispondono a domande reali. Nascono da dati di customer care, query di ricerca, obiezioni commerciali, conversazioni con gli utenti, recensioni, ticket, call sales, chat interne o analisi dei competitor.

Le FAQ cosmetiche, invece, vengono inserite solo per allungare la pagina o intercettare keyword long tail. Sono spesso generiche, ripetitive e intercambiabili tra decine di URL.

Esempio di FAQ debole:

Domanda: Perché scegliere il nostro servizio?

Risposta: Perché offriamo qualità, professionalità e convenienza.

Questa FAQ non aggiunge nulla. Non risponde a un dubbio specifico, non riduce incertezza, non aiuta la conversione e non migliora la comprensione della pagina.

Esempio di FAQ forte:

Domanda: Quanto tempo serve per migrare un sito WordPress da HTTP a HTTPS senza perdere traffico organico?

Risposta: Per un sito piccolo la migrazione può richiedere poche ore operative, ma il monitoraggio SEO dovrebbe continuare per almeno 2-4 settimane. Vanno controllati redirect 301, canonical, sitemap, Search Console, mixed content, link interni e variazioni di indicizzazione.

Qui la risposta è concreta. Aiuta l’utente, anticipa obiezioni, dimostra competenza e arricchisce semanticamente la pagina.

Impatto su e-commerce, blog, siti locali e B2B

La rimozione della feature non colpisce tutti allo stesso modo. Il valore residuo delle FAQ dipende dal tipo di sito e dal ruolo che quelle domande hanno nel percorso dell’utente.

E-commerce

Negli e-commerce le FAQ non servono solo alla SEO. Servono a ridurre attrito prima dell’acquisto.

Domande su spedizione, resi, compatibilità, materiali, taglie, garanzia, disponibilità e tempi di consegna possono incidere direttamente sulla conversione.

Per questo motivo, anche senza rich result, le FAQ possono restare importanti nelle schede prodotto, nelle categorie strategiche e nelle pagine informative collegate al funnel.

Blog e magazine

Nei contenuti editoriali le FAQ devono evitare l’effetto “appendice SEO”. Se il tema è già spiegato bene nell’articolo, una sezione FAQ può servire a sintetizzare punti chiave, chiarire dubbi ricorrenti o coprire sotto-intenti non trattati nel corpo principale.

Se invece la FAQ ripete frasi già presenti nel testo, diventa rumore.

Siti locali

Per attività locali, professionisti e servizi territoriali, le FAQ possono essere ancora molto utili. Orari, zone servite, modalità di prenotazione, documenti richiesti, tempi di intervento e costi indicativi sono informazioni ad alto valore pratico.

Anche senza espansione in SERP, queste risposte migliorano la qualità della landing page e possono ridurre chiamate inutili o richieste non qualificate.

B2B e servizi complessi

Nel B2B le FAQ possono aiutare a spiegare processi lunghi, criteri di accesso, modelli di pricing, tempistiche, deliverable e responsabilità del cliente.

Qui il valore non è il rich result. Il valore è commerciale: ridurre incertezza e portare l’utente più vicino alla richiesta di contatto.

Dati strutturati dopo i FAQ rich results: cosa resta importante

La rimozione delle FAQ non riduce l’importanza complessiva dei dati strutturati. Riduce l’importanza di una specifica aspettativa: implementare schema per ottenere automaticamente una decorazione in SERP.

I dati strutturati restano utili quando aiutano i motori a comprendere meglio entità, relazioni e proprietà di una pagina.

Per molti siti, le priorità possono spostarsi su altri markup più coerenti con il business:

- Organization per descrivere l’entità aziendale;

- LocalBusiness per attività locali;

- Product per schede prodotto;

- Review e AggregateRating, dove ammessi e corretti;

- Article o BlogPosting per contenuti editoriali;

- BreadcrumbList per struttura e navigazione;

- VideoObject per contenuti video;

- Event per eventi reali;

- JobPosting per offerte di lavoro.

La regola è sempre la stessa: prima viene il contenuto reale, poi il dato strutturato che lo descrive. Non il contrario.

FAQ, AI Overviews e motori generativi

La rimozione dei FAQ rich results arriva in una fase in cui la SEO sta cambiando anche per effetto di AI Overviews, motori generativi, chatbot di ricerca e sistemi di risposta sintetica.

Questo porta a una domanda inevitabile: se Google non mostra più i FAQ rich results, ha ancora senso strutturare contenuti in formato domanda-risposta?

Sì, ma con una precisazione: non perché il formato FAQ garantisca visibilità nei sistemi AI. Nessun markup garantisce citazioni, sintesi o inclusioni automatiche in AI Overviews, ChatGPT, Gemini, Perplexity o Copilot.

Ha senso perché il formato domanda-risposta può essere molto leggibile per utenti e macchine quando risponde a intenti reali.

I sistemi generativi lavorano su segnali multipli: contenuto testuale, contesto, entità, autorevolezza, freschezza, citazioni, coerenza, struttura della pagina, fonti esterne e qualità complessiva del documento.

Le FAQ possono aiutare solo se fanno parte di un contenuto solido. Non sono una scorciatoia per entrare nell’AI Search. Sono un formato utile quando chiariscono informazioni che l’utente potrebbe cercare in forma conversazionale.

Il rischio strategico: inseguire la SERP invece dell’utente

La storia dei FAQ rich results mostra un problema ricorrente nella SEO: la tendenza a trasformare ogni opportunità di visibilità in una formula replicabile.

Quando Google introduce una feature, il mercato reagisce spesso nello stesso modo:

- la feature viene scoperta;

- vengono pubblicate guide per implementarla;

- i plugin la automatizzano;

- i siti la usano in massa;

- la qualità media scende;

- Google riduce o rimuove la feature.

Questo ciclo si è visto più volte. Non riguarda solo le FAQ. Riguarda review snippet, HowTo, video, immagini, markup abusati, elementi di SERP e qualunque formato possa essere manipolato per ottenere visibilità aggiuntiva.

La lezione è semplice: una strategia SEO non dovrebbe dipendere da feature che Google può spegnere dall’oggi al domani.

Le feature sono opportunità tattiche. I contenuti, l’architettura, la reputazione e la capacità di rispondere meglio degli altri all’intento di ricerca sono asset strategici.

Audit operativo: cosa controllare adesso

Chi gestisce siti con dati strutturati FAQ dovrebbe fare un audit leggero ma ordinato. Non serve cancellare tutto, ma serve sapere cosa è presente, dove, perché e con quale qualità.

1. Individuare tutte le pagine con FAQPage

Il primo passo è mappare le URL che contengono markup FAQPage. Si può fare con un crawler SEO, con una scansione del codice sorgente, con esportazioni dal CMS o con script personalizzati.

Per ogni URL conviene registrare:

- tipo di pagina;

- template usato;

- numero di domande;

- origine delle FAQ;

- presenza del contenuto visibile in pagina;

- validità tecnica del markup;

- traffico organico della pagina;

- ruolo della pagina nel funnel.

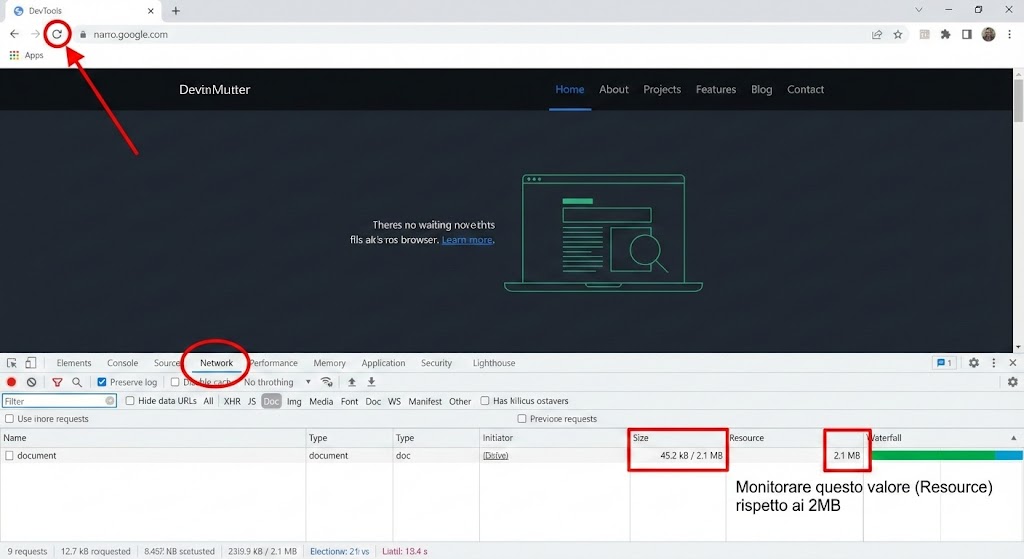

2. Verificare la corrispondenza tra markup e pagina

Le domande e le risposte dichiarate nel dato strutturato devono essere presenti anche nel contenuto visibile. Se il markup contiene testo non mostrato all’utente, contenuti vecchi o risposte diverse da quelle pubblicate, va aggiornato.

3. Separare FAQ strategiche e FAQ decorative

Non tutte le FAQ meritano lo stesso trattamento. Le FAQ strategiche rispondono a dubbi reali e possono influenzare comprensione, fiducia e conversione. Le FAQ decorative servivano solo a ottenere il rich result.

Le prime vanno migliorate. Le seconde vanno eliminate o integrate meglio nel contenuto principale.

4. Esportare i dati storici

Prima della scomparsa completa dei report, conviene esportare i dati storici legati ai FAQ rich results da Search Console.

Questo permette di conservare uno storico utile per analisi future, soprattutto se il sito ha beneficiato della feature negli anni precedenti.

5. Aggiornare dashboard e automazioni

Chi usa Looker Studio, API, script o report ricorrenti deve rimuovere filtri e dipendenze legati alla search appearance FAQ.

Meglio intervenire prima che il dato sparisca, invece di ritrovarsi con report vuoti o errori nelle automazioni.

6. Rivedere le linee guida editoriali

Se nel processo editoriale era prevista l’aggiunta automatica di una sezione FAQ a ogni articolo, è il momento di cambiare approccio.

Le FAQ non devono essere un obbligo di template. Devono essere una scelta editoriale.

Come riscrivere le FAQ dopo l’aggiornamento

Una buona sezione FAQ dovrebbe nascere da domande concrete. Non da keyword inserite in forma interrogativa.

Per riscrivere una FAQ in modo utile, conviene partire da quattro fonti:

- query reali da Search Console;

- domande commerciali ricevute da clienti e prospect;

- obiezioni ricorrenti prima dell’acquisto o della richiesta di contatto;

- lacune informative presenti nei contenuti competitor.

Una FAQ efficace ha alcune caratteristiche riconoscibili:

- risponde a una domanda specifica;

- non ripete semplicemente il contenuto già scritto sopra;

- usa parole comprensibili dall’utente;

- contiene informazioni verificabili;

- non promette più di quanto il contenuto possa dimostrare;

- riduce incertezza o attrito decisionale;

- può essere letta anche fuori contesto senza perdere significato.

Il formato migliore non è sempre domanda-risposta. A volte una tabella, una checklist, un confronto o un blocco “cosa sapere prima di acquistare” funzionano meglio.

La fine del rich result FAQ può quindi essere un’occasione positiva: meno automatismi SEO, più progettazione del contenuto.

Checklist tecnica per SEO e sviluppatori

Dal punto di vista tecnico, il lavoro consigliato è questo:

- scansionare il sito per individuare tutte le implementazioni

FAQPage; - controllare se il markup è generato da tema, plugin, CMS o codice custom;

- verificare la validità JSON-LD;

- eliminare duplicazioni tra più plugin SEO;

- controllare che ogni domanda abbia una risposta coerente;

- rimuovere FAQ vuote, duplicate o boilerplate;

- conservare il markup dove descrive contenuti utili e visibili;

- aggiornare documentazione tecnica interna;

- rimuovere KPI legati ai FAQ rich results dai report futuri;

- monitorare eventuali variazioni di CTR su pagine storicamente interessate.

Una buona implementazione JSON-LD non deve essere lasciata al caso. Anche se non genera più un rich result, resta parte del codice della pagina e deve essere mantenuta pulita.

Come spiegare la novità a un cliente

Per consulenti e agenzie, questa notizia va comunicata con precisione. Dire “Google ha eliminato le FAQ” è sbagliato. Dire “non servono più le FAQ” è ancora più sbagliato.

Una spiegazione corretta potrebbe essere:

Google ha rimosso la visualizzazione espansa delle FAQ nei risultati di ricerca. Questo non penalizza il sito e non obbliga a cancellare le FAQ. Dobbiamo però aggiornare il modo in cui valutiamo questo markup: non è più una leva per ottenere spazio aggiuntivo in SERP, ma può restare utile se migliora chiarezza, esperienza utente e comprensione semantica della pagina.

Questo tipo di comunicazione evita allarmismi e sposta la discussione sul punto giusto: la qualità del contenuto, non la nostalgia per una feature di Google.

Errori da evitare

La fase successiva a ogni aggiornamento Google produce sempre interpretazioni estreme. Anche in questo caso ci sono alcuni errori da evitare.

Errore 1: cancellare tutte le FAQ

Le FAQ non sono diventate inutili. È diventata inutile l’aspettativa di ottenere un rich result visibile in Google Search.

Errore 2: lasciare FAQ scadenti solo perché “male non fanno”

È vero che un markup non utilizzato non è automaticamente un problema. Ma contenuti inutili, duplicati o scritti male peggiorano comunque la qualità percepita della pagina.

Errore 3: misurare il valore delle FAQ solo sul CTR

Le FAQ possono aiutare conversioni, supporto clienti, chiarezza informativa e comprensione del servizio. Il CTR organico non è l’unica metrica.

Errore 4: confondere schema markup e ranking factor

I dati strutturati aiutano a descrivere contenuti, ma non trasformano automaticamente una pagina mediocre in una pagina competitiva.

Errore 5: ignorare dashboard e API

La parte più concreta del lavoro potrebbe essere proprio nei report. Se un sistema continua a cercare una search appearance che non esiste più, il problema diventa tecnico e operativo.

Una lettura più ampia: Google vuole SERP più controllate

La rimozione dei FAQ rich results si inserisce in una trasformazione più grande della ricerca.

Google sta progressivamente riducendo alcune feature facilmente attivabili dai siti e aumentando il peso di elementi controllati direttamente dal motore: AI Overviews, knowledge panel, moduli verticali, risultati arricchiti selettivi, contenuti generati o sintetizzati, risposte immediate e layout dinamici.

Questo non significa che la SEO tecnica perda valore. Significa che deve smettere di essere vista come un insieme di trucchi per accendere badge in SERP.

La SEO tecnica utile oggi è quella che rende un sito:

- facile da scansionare;

- facile da interpretare;

- veloce;

- accessibile;

- semanticamente chiaro;

- coerente tra contenuto visibile e codice;

- solido nei segnali di entità;

- misurabile con dati puliti.

In questo contesto, i dati strutturati non scompaiono. Cambia il modo in cui vanno valutati.

Cosa fare nelle prossime settimane

Per gestire bene questo cambiamento, la priorità non è intervenire in modo impulsivo. La priorità è ordinare il lavoro.

Un piano pratico può essere questo:

- Settimana 1: esportare i dati storici da Search Console e individuare le pagine con markup FAQ.

- Settimana 2: controllare qualità, duplicazioni e coerenza delle FAQ più importanti.

- Settimana 3: aggiornare dashboard, API, template di report e documentazione interna.

- Settimana 4: riscrivere o rimuovere FAQ deboli, mantenendo quelle utili per utenti e conversioni.

- Dopo 30-60 giorni: confrontare CTR, click e comportamento utente sulle pagine principali, evitando attribuzioni affrettate.

Il lavoro migliore non sarà quello di chi cancella più markup. Sarà quello di chi distingue tra codice inutile, contenuto utile e dati davvero necessari per interpretare correttamente una pagina.

FAQ operative

Google ha eliminato completamente le FAQ?

No. Google ha eliminato i FAQ rich results nella Ricerca. Le FAQ possono restare nella pagina e il tipo di dato strutturato FAQPage continua a esistere come vocabolario Schema.org.

Il markup FAQPage è ancora valido?

Sì, il markup può essere ancora valido se descrive correttamente contenuti visibili nella pagina. Il fatto che Google non mostri più il rich result non rende automaticamente errato il markup.

Le FAQ aiutano ancora la SEO?

Possono aiutare se migliorano il contenuto, chiariscono dubbi reali, coprono sotto-intenti utili e rendono la pagina più completa. Non aiutano più come scorciatoia per ottenere spazio aggiuntivo in SERP.

Conviene togliere tutte le sezioni FAQ dagli articoli?

No. Conviene rimuovere solo le FAQ artificiali, ripetitive o create esclusivamente per intercettare il rich result. Le FAQ utili agli utenti possono restare.

Cosa succede ai dati in Search Console?

I report e le search appearance dedicate ai FAQ rich results verranno rimossi. Anche il supporto nella Search Console API sarà dismesso, quindi dashboard e automazioni devono essere aggiornate.

Questa modifica può causare un calo di traffico?

Può influire sul CTR solo nei casi in cui il sito riceveva ancora visibilità tramite FAQ rich results. Per molti siti l’impatto sarà limitato, perché Google aveva già ridotto questa feature dal 2023.

FAQPage può aiutare nei motori AI?

Non c’è una garanzia diretta. Tuttavia, contenuti chiari, ben strutturati e coerenti possono essere più facili da comprendere per sistemi automatici. Il formato FAQ va usato quando migliora davvero la qualità informativa.